tg-me.com/ds_interview_lib/644

Last Update:

Что такое кросс-энтропия?

Это одна из функций потерь, используемых в машинном обучении. Её ещё называют перекрёстной энтропией или log loss.

Кросс-энтропия измеряет разницу между фактическими метками и предсказанными вероятностями модели. Она широко используется в задачах классификации, особенно в нейронных сетях. Чем больше разница между предсказанной моделью вероятностью и истинным значением, тем выше значение кросс-энтропии.

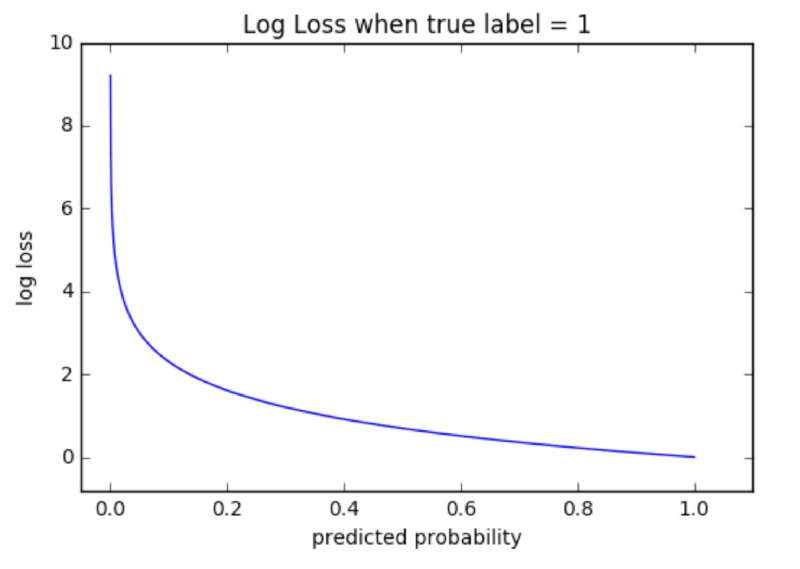

👆График выше показывает диапазон возможных значений потерь, когда истинная метка равна единице (isDog = 1). По мере приближения предсказанной вероятности к 1 логарифмическая потеря медленно уменьшается. Однако при снижении предсказанной вероятности логарифмическая потеря резко возрастает. Логарифмическая потеря штрафует оба типа ошибок, но особенно те предсказания, которые уверенные, но ошибочные.

#машинное_обучение

BY Библиотека собеса по Data Science | вопросы с собеседований

Share with your friend now:

tg-me.com/ds_interview_lib/644